《AI写作算法全面解析:赋能内容创作,提升文章质量与效率》

在数字化时代浪潮的推动下人工智能()已逐渐成为各行各业的要紧助力。其在内容创作领域写作算法的应用正以前所未有的速度改变着传统的创作模式。本文将全面解析写作算法的原理与应用,探讨其怎么样赋能内容创作提升文章优劣与效率,让创作者们可以在海量的信息中高效地提炼观点,创作出更具深度与广度的优质内容。

## 写作原理

### 写作的底层逻辑

写作的底层逻辑基于深度学技术,其是自然语言应对(NLP)领域的发展。通过分析大量的文本数据,学语言的语法、语义和上下文关系,从而生成连贯、有逻辑的文本。这一过程涉及到数据预解决、模型训练、文本生成等多个环节。

### 关键技术

关键技术涵词向量表示、循环神经网络(RNN)、长短期记忆网络(LSTM)和关注力机制等。这些技术使得可以理解语言的复杂结构,生成更具创意和逻辑性的文本。

## 写作

### 写作过程

写作的过程一般涵以下几个步骤:接收输入的提示或主题;按照已训练的模型生成文本;接着对生成的文本实行优化和调整; 输出完整的文章。整个过程高效、快速,大大缩短了创作周期。

### 应用场景

写作的应用场景广泛,包含新闻报道、广告文案、产品描述、社交媒体内容等。在新闻领域,写作可以快速生成新闻报道增强新闻的时效性;在广告营销中,写作能够依据使用者喜好生成个性化的广告文案,提升转化率。

## 写作是什么意思

### 定义

写作,指的是利用人工智能技术自动生成文本的过程。这类技术不仅能够模仿人类的写作风格,还能够按照特定的主题和需求,生成具有创意和逻辑性的文章。

### 意义

写作的意义在于,它能够解放人类的创作力,让创作者有更多的时间和精力去关注更高级别的创意思考。同时写作还能够提升写作的效率减少重复劳动,为内容创作带来新的可能性。

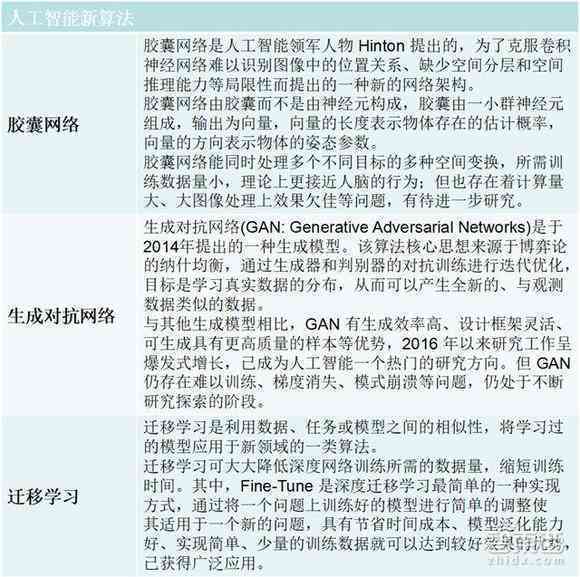

## 的算法

### 主流算法

写作的主流算法包含生成对抗网络(GAN)、变分自编码器(VAE)等。这些算法通过模拟人类的创作过程,生成具有多样性和创新性的文本。

### 优缺点

写作算法的优点在于高效、准确、可扩展性强。它能够快速生成大量文本满足不同场景和需求。写作算法也有其局限性如难以理解复杂的情感和语境,有时生成的文本可能缺乏人类的直觉和创造力。

## 写作模型

### 常见模型

常见的写作模型有GPT(生成预训练模型)、BERT(双向编码器表示)等。这些模型在应对自然语言时表现出色能够生成高优劣的文章。

### 模型训练

写作模型的训练需要大量的文本数据。在训练期间,模型会学文本的语法、语义和上下文关系,从而增强生成的文本品质。模型的训练还需要考虑数据的多样性和平性,以避免生成具有偏见或错误信息的文本。

以下是对各个小标题的详细解答:

## 写作原理

### 写作的底层逻辑

写作的核心原理基于深度学技术,特别是自然语言应对(NLP)领域的研究成果。系统通过分析海量的文本数据,学语言的语法规则、词汇搭配、句子结构等,从而能够模仿人类的写作风格。这一过程涉及到数据的预应对、模型的训练和优化等多个环节。

在预应对阶,系统会对文本数据实清洗、分词等操作,以便于后续的解决。接着在模型训练阶系统会通过神经网络学文本的内在规律。其中,词向量表示技术将词汇映射为高维空间中的向量,使能够理解词汇的语义和上下文关系。循环神经网络(RNN)和长短期记忆网络(LSTM)则能够解决长序列数据,生成连贯的文本。

### 关键技术

写作的关键技术包含词向量表示、循环神经网络(RNN)、长短期记忆网络(LSTM)和关注力机制等。词向量表示技术通过将词汇映射为高维空间中的向量,使能够理解词汇的语义和上下文关系。循环神经网络(RNN)和长短期记忆网络(LSTM)则能够解决长序列数据,生成连贯的文本。

留意力机制是一种关键的技术,它使得能够在生成文本时关注到关键信息,增进文本的优劣。深度学框架如TensorFlow和PyTorch等,也为写作的实现提供了强大的支持。

## 写作

### 写作过程

写作的过程可分为以下几个步骤:系统接收输入的提示或主题;依据已训练的模型生成文本;接着对生成的文本实行优化和调整; 输出完整的文章。

在接收输入提示或主题后,系统会依照已训练的模型

《AI写作算法全面解析:赋能内容创作,提升文章质量与效率》

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/373190.html

上一篇:文本实小编:分析工具与生成编组训练一站式解决方案

下一篇:探秘热门AI创作平台:盘点当前火爆的字语智能、即梦AI、橙篇等创新工具

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1探寻高效AI文本工具:一键生成优质内容的秘密基地

- 1文本实小编:分析工具与生成编组训练一站式解决方案

- 1AI文本分析与应用:深入探索自然语言处理技术及其多元化应用解决方案

- 1揭秘AI写作:深入探索底层逻辑与智能创作原理

- 1ai写作商单:探索AI写作原理、算法及模型

- 1AI写作生成器在安设备上的检测与防范:全面指南与实用技巧

- 1AI智能写作大师:是否实使用限制与禁令规定

- 1指南Guide:探秘指南龟的发明与历沿革

- 1精选创意文案子汇编:覆热门话题与用户搜索需求大全

- 1ai写作怎么问问题不回答呢:探讨AI写作提问技巧与常见问题解决方案

- 1惊叹AI特效的魅力:领略前沿智能技术的视觉震撼

- 1AI一键合并、编辑和打开多页PDF文件:多功能解决方案助力文档管理效率提升

- 1ai置入多页pdf:如何制作、编辑及导入编辑多页PDF文件教程

- 1如何利用AI高效打开并浏览多页PDF文档

- 1Adobe Illustrator中高效打开和编辑多页PDF文件的完整指南

- 1ai怎么打开多页的pdf - 一次性处理多个文件方法介绍

- 1高效智能写作助手套装:AI写作软件精选推荐指南

- 1全面盘点:市面上更受欢迎的AI写作软件套装及其综合应用指南